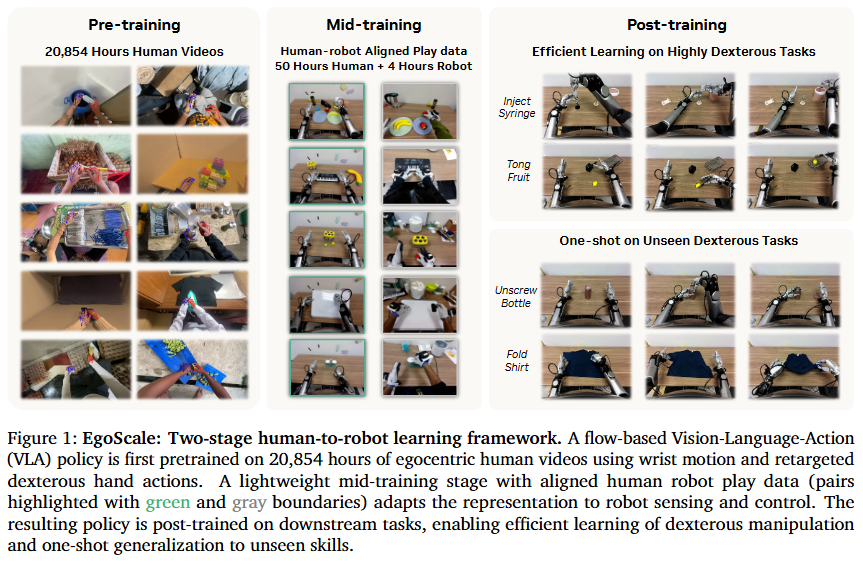

研究团队提出的EgoScale,是一款基于大规模第一视角人类数据构建的视觉 - 语言 - 动作(VLA)迁移框架。它突破现有研究的数据规模瓶颈,在 2 万小时带动作标签的第一视角人类视频上训练,规模达到此前同类研究的 20 倍以上,还发现人类数据规模与模型验证损失的对数线性缩放定律,成功实现从人类操作到机器人灵巧动作的高效迁移,为通用人机灵巧操作提供了数据高效、泛化性强的解决方案。

现有人机操作迁移方法难以实现通用化、高精度落地,核心问题集中在:

传统 VLA 模型训练数据多为数千小时级,且场景单一(如固定桌面操作),无法覆盖人类日常操作的丰富场景(如厨房烹饪、工具使用、户外维修),导致模型泛化能力差,难以适配复杂现实场景。

人类手部与机器人机械臂的自由度、运动机理差异显著,直接模仿人类动作易出现 “动作失真”“操作失效”,缺乏有效的跨形态迁移机制。

现有方法未充分挖掘人类数据的价值,未发现数据规模与模型性能的量化关系,导致需重复采集机器人专用数据,训练成本高、周期长。

EgoScale 的核心突破:以超大规模第一视角人类数据为基础,通过对数线性缩放定律优化模型训练,结合跨形态迁移机制,实现 “大规模人类数据预训练 + 少量机器人数据微调” 的高效迁移,大幅降低对机器人专用数据的依赖。

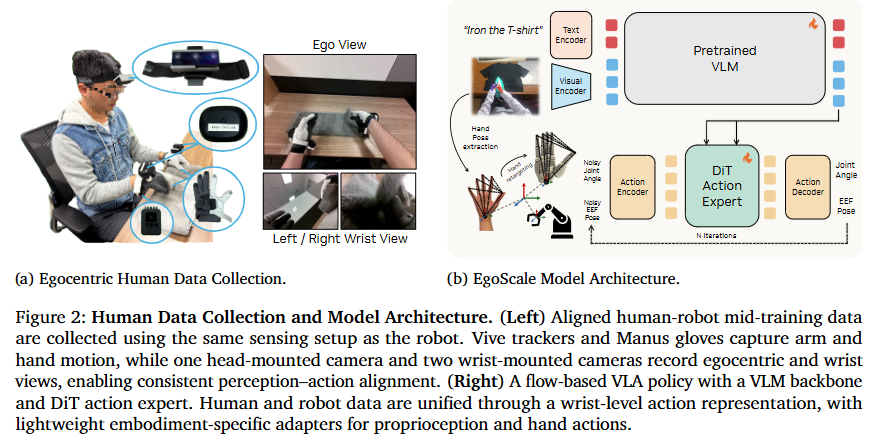

EgoScale 以 “大规模数据采集 - 缩放定律建模 - 跨形态迁移” 为核心链路,通过三大核心设计,解锁人机灵巧操作迁移的通用能力:

构建大规模、高质量的第一视角人类操作数据集,为模型提供充足的通用操作先验:

数据规模:累计 2 万小时带动作标签的第一视角视频,涵盖家庭、工业、户外等 12 类核心场景,包含烹饪、组装、维修、清洁等 500 + 细分操作任务,动作标签细粒度到 “抓取 - 旋转 - 放置” 等基础操作单元;

数据来源:整合公开第一视角数据集、专业录制的操作视频、互联网共享操作内容,通过自动标注 + 人工校验的方式,确保动作标签的准确性;

数据特点:包含丰富的环境多样性(不同光照、纹理、物体形态)和操作风格差异(不同人群的操作习惯),为模型泛化能力奠定基础。

多模态对齐:统一同步视频帧、语言描述(如 “用螺丝刀拧紧螺丝”)、动作标签(关节角度序列、操作步骤),构建 “视觉 - 语言 - 动作” 三位一体的标注体系;

噪声过滤:移除模糊、遮挡严重、动作不完整的视频片段,保留高质量操作数据;

格式统一:将人类手部动作参数化为标准化关节角度序列,为后续跨形态迁移提供统一接口。

通过大规模实验发现关键规律,最大化数据利用效率:

模型验证损失与人类数据规模呈对数线性关系:随着数据规模从 100 小时增长到 2 万小时,模型验证损失持续下降且未出现饱和,证明扩大人类数据规模是提升模型通用操作能力的关键;

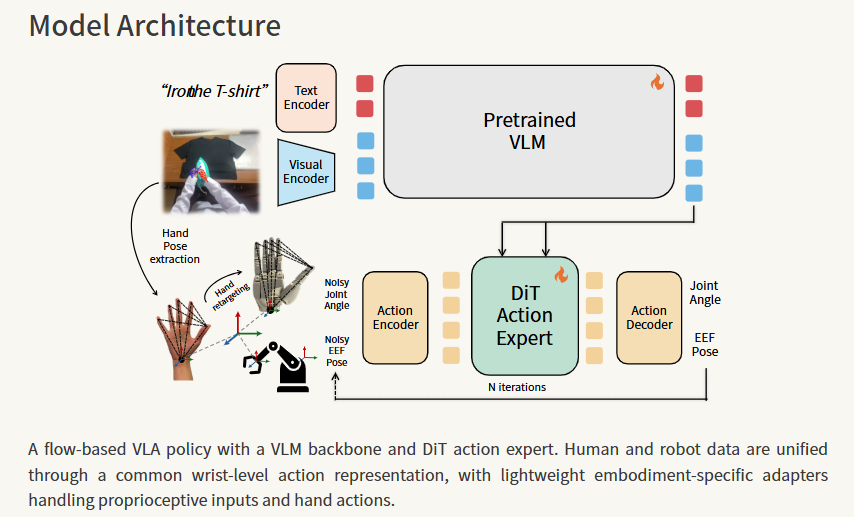

采用混合专家(MoE)架构,适配超大规模数据训练,在保证模型容量的同时控制计算成本;

视觉编码器采用分层设计,提取从局部物体特征到全局场景特征的多维度视觉信息;语言编码器融入操作任务的语义理解,精准关联 “指令意图 - 操作动作”;动作解码器支持灵活的动作生成,适配不同形态机器人的输出需求。

解决人机形态差异导致的迁移难题,实现高效能力适配:

设计轻量级动作映射网络,将标准化的人类手部动作序列,转化为目标机器人(如机械臂、人形机器人手部)的关节控制指令,映射过程中考虑机器人的自由度约束、运动范围限制,确保动作物理可行;

通过少量机器人真实操作数据(仅需人类数据规模的 1%),微调视觉特征与机器人动作的对齐关系,修正因相机视角、物体尺寸差异导致的迁移偏差;

模型学习人类操作的任务逻辑(如 “打开瓶盖需先抓取边缘再旋转”),而非单纯模仿动作轨迹,确保迁移到机器人后,能根据实际场景动态调整动作,应对物体位置偏移、轻微遮挡等现实扰动。

EgoScale 在多个灵巧操作基准测试与真实机器人平台上完成验证,表现全面超越现有方法:

通用操作准确率:在 50 类未见操作任务中,平均成功率达 89%,较基于 1000 小时数据的基线模型提升 35%;

缩放定律验证:数据规模每扩大 1 倍,模型验证损失下降约 8%,与对数线性关系拟合度达 0.98,证明数据规模的核心价值;

泛化能力:面对训练中未见过的物体(如特殊形状的工具)、环境(如低光照厨房),任务成功率仅下降 5%-8%,远优于基线模型的 20%-30%。

在 Franka 机械臂、Unitree 灵巧手等平台上,EgoScale 实现多种复杂灵巧操作:

日常操作:抓取不规则物体(如水果、折叠衣物)、工具使用(螺丝刀拧螺丝、剪刀裁剪纸张),成功率超 90%;

精细操作:插拔 USB 接口、倾倒液体、组装小型零件,动作精准、平稳,无明显抖动或碰撞;

数据效率:仅需 100 小时机器人微调数据,即可达到传统方法使用 1000 小时机器人数据的性能,数据效率提升 10 倍。

数据规模:是现有同类研究的 20 倍以上,覆盖场景更全面,泛化能力更强;

迁移效率:依赖对数线性缩放定律,大幅降低机器人专用数据需求,落地成本更低;

操作通用性:学习人类操作的核心逻辑,而非特定动作,适配更多任务与机器人形态。

数据规模领先:2 万小时第一视角数据构建坚实基础,挖掘对数线性缩放定律,最大化数据价值;

迁移效率高:少量机器人数据即可完成适配,大幅降低训练成本与周期;

泛化性强:覆盖丰富场景与操作任务,能应对未见过的物体、环境与扰动;

通用兼容:支持多种机器人形态,无需为特定硬件重构模型,适配性广。

动态场景适配不足:当前聚焦静态或低速操作任务,对高速动态目标(如抓取飞行物体)的迁移效果需进一步验证;

力反馈融合欠缺:未充分融入触觉传感器数据,对需要精细力控制的场景(如轻柔捏取易碎品)适配有限;

复杂工具迁移待优化:面对高度专业化的工具(如精密仪器),因人类操作数据中覆盖不足,迁移精度可能下降。

EgoScale 的核心价值在于:首次通过 2 万小时大规模第一视角人类数据,揭示数据规模与模型性能的对数线性缩放定律,构建了高效的人机灵巧操作迁移框架,打破了传统方法对机器人专用数据的依赖,为人形机器人、工业机械臂等在家庭服务、工业协作、医疗辅助等场景的通用灵巧操作落地提供了关键支撑。

Donghu Robot Laboratory, 2nd Floor, Baogu Innovation and Entrepreneurship Center,Wuhan City,Hubei Province,China

Tel:027-87522899,027-87522877

Donghu Robot Laboratory, 2nd Floor, Baogu Innovation and Entrepreneurship Center,Wuhan City,Hubei Province,China

Tel:027-87522899,027-87522877